Pycharm远程连接深度学习服务器Autodl实现模型训练

目录

0 前言

1 问题背景

2 问题解决

2.1 进入算力市场

2.2 筛选与选择心仪的机器

2.3 镜像选择

2. 4 打开Pycharm进行网络配置

0 前言

🙋欢迎光临我的博客!我衷心希望这里的分享能够对你有所帮助。祝愿你拥有美好的一天!

1 问题背景

在深度学习的探索与实践中,我们常常会遇到一个核心矛盾:强大的模型需要强大的算力,但个人设备的GPU资源往往捉襟见肘。 配置本地环境、处理版本冲突、等待漫长的训练过程……这些“琐事”常常会分散我们本应聚焦于模型与算法本身的精力。

此时,AutoDL这样的云GPU租赁平台便成为了我们的得力助手。它就像是一个随时待命的“超级计算机”租赁中心,为我们提供了触手可及的强大算力。

AutoDL平台的核心优势在于:

-

开箱即用的环境:AutoDL为我们预配置了主流的深度学习框架(如PyTorch, TensorFlow)和常用库。你无需在本地进行繁琐的环境配置,只需选择所需的镜像,即可在几分钟内获得一个纯净、稳定、功能齐全的深度学习环境,真正实现了“开机即用”。

-

极致的性价比与丰富选择:平台提供了多种按需计费的GPU机型,从性价比极高的RTX 4090到顶尖的A100、H800等专业计算卡。你可以根据自己任务的算力需求和预算,灵活选择最合适的机器,按实际使用时长付费,成本可控,避免了硬件投资的巨大开销。

-

高效的数据管理:AutoDL提供了网盘、数据集广场等功能,你可以轻松上传个人代码和数据,或直接加载平台预存的公开数据集(如COCO, ImageNet等)。结合其高速的内网传输,数据准备工作变得异常高效。

-

便捷的远程访问:通过直观的Web控制台,你可以像操作本地电脑一样使用远程实例。更重要的是,AutoDL支持Jupyter Lab和SSH连接,这为我们使用PyCharm等专业IDE进行远程开发与调试铺平了道路,能够将本地流畅的编码体验与云端强大的计算能力完美结合。

总而言之,AutoDL极大地降低了深度学习的入门与应用门槛,将复杂的硬件和环境问题打包成一项简单的服务。在接下来的部分,我们将一步步探索如何利用PyCharm这一强大IDE,无缝连接到AutoDL的云端实例,打造一个集编码、调试、训练于一体的高效工作流。

2 问题解决

当你成功登录AutoDL官网后(AutoDL算力云 | 弹性、好用、省钱,GPU算力零售价格新标杆),按照以下步骤即可快速租用并启动一台云端GPU服务器。

2.1 进入算力市场

在“算力市场”首页,涵盖所有可用GPU实例。在使用前,你可先进行“学生认证”,充值一定的金额,方便后续租用(即使你在后面使用无卡开机,也是需要0.1/h计费的,学生认证有一定的优惠)。

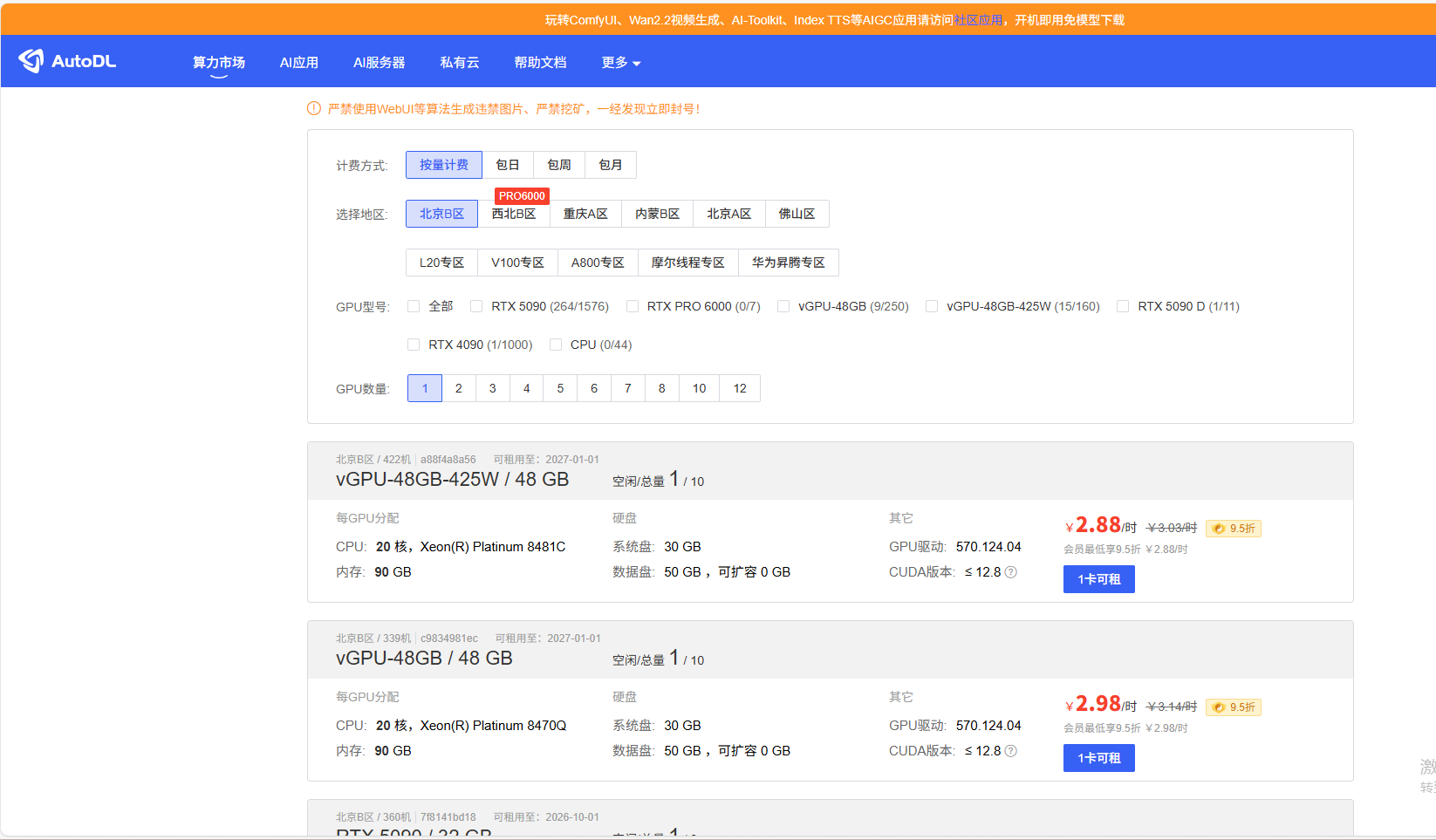

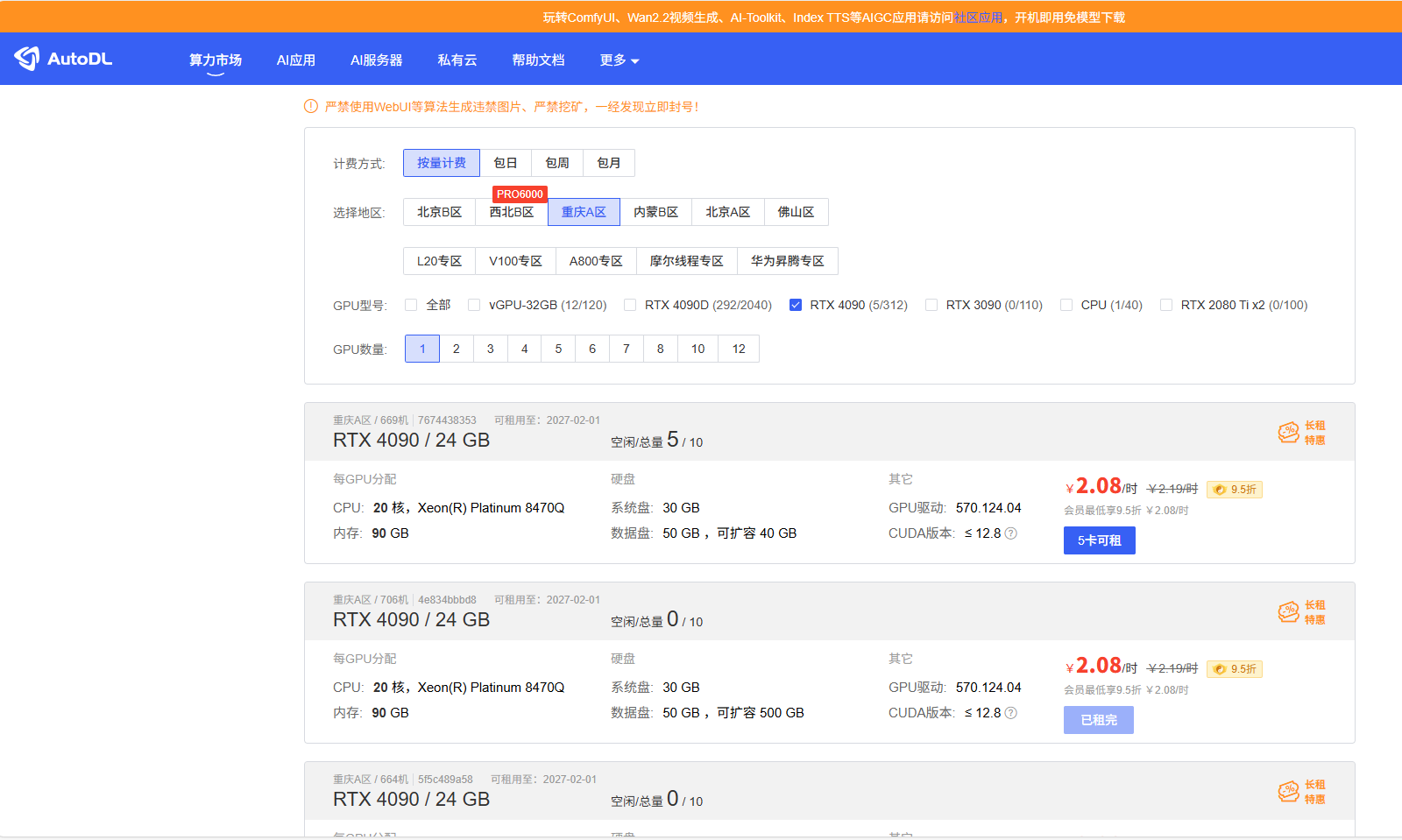

2.2 筛选与选择心仪的机器

你会看到一个机器列表,此时需要根据你的需求进行筛选:

-

地区:主要看你选的显卡,哪里有你需要的显卡就在哪里进行租用。

-

GPU型号:根据你的算力需求和预算选择。例如:

-

RTX 4090:性价比极高,适合大部分学术研究和中等规模的模型训练。

-

A100 / A800:适用于大规模模型训练和非常复杂的任务。

-

操作:找到合适的机器后,点击卡片上的 “1卡可租” 按钮。这里我们以重庆A区4090D为例子。

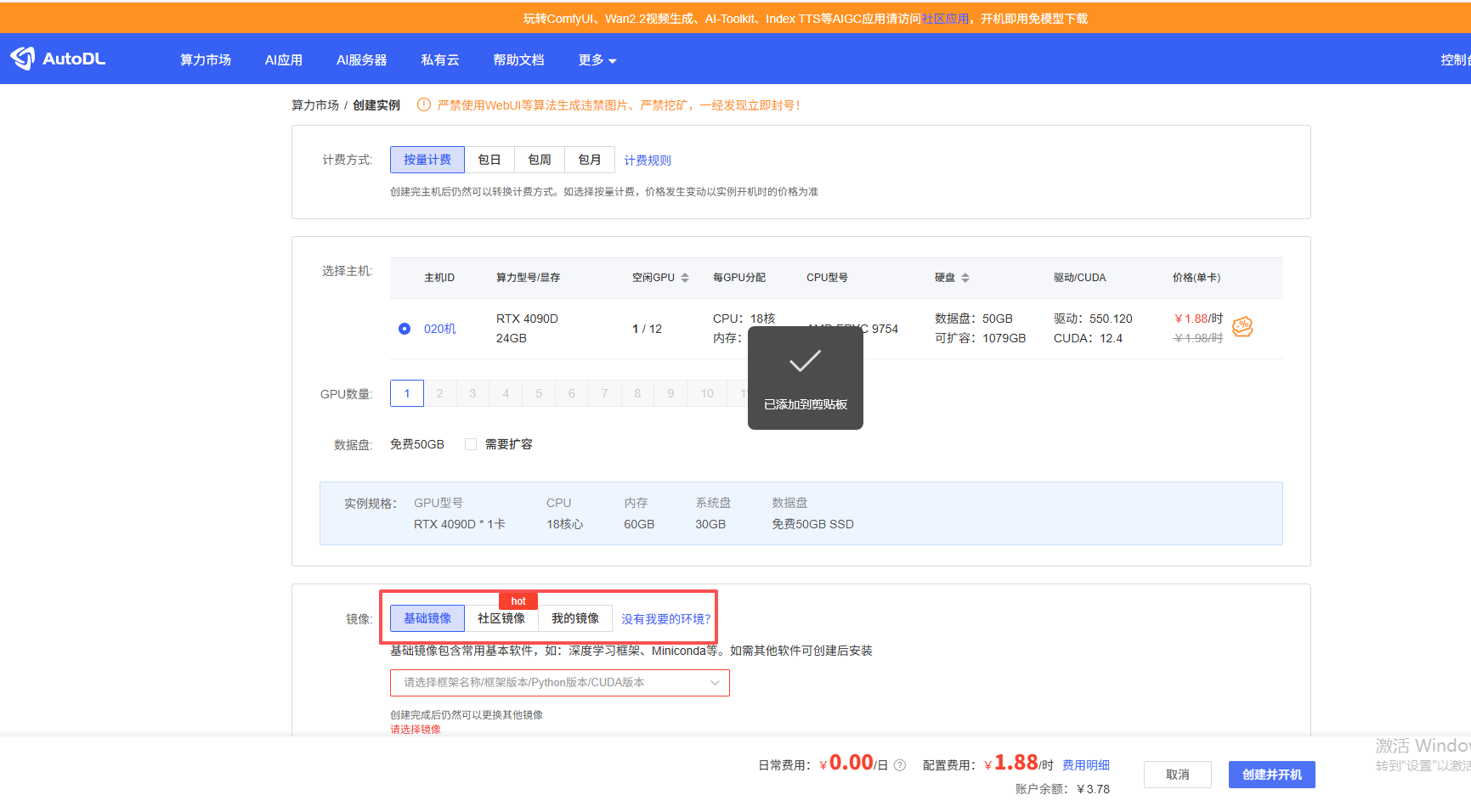

2.3 镜像选择

在租用服务器时,“镜像” 就是你云服务器的预装操作系统和软件环境。AutoDL提供了三类镜像,它们决定了你开机后能立即使用的工具和框架。

我们这里使用“基础镜像”,自己配置服务器,但是如果社区镜像有你所需要的模型也可以直接选择社区模型。以下为各类镜像的介绍:

-

基础镜像

-

是什么:一个非常“干净”的系统环境,通常只预装了最基础的Python、CUDA驱动和conda包管理器,不包含PyTorch、TensorFlow等特定深度学习框架。

-

适用场景:

-

你需要一个极度纯净、高度定制化的环境。

-

你打算从零开始手动安装所有依赖,以解决特定版本冲突问题。

-

你正在学习环境配置,想亲手实践。

-

-

-

社区镜像

-

是什么:由AutoDL官方或社区用户预配置好的、包含各种流行框架和工具的“增强版”环境。你可以找到预装了PyTorch、TensorFlow、JupyterLab、OpenCV等全套工具的镜像。

-

适用场景:

-

绝大多数深度学习项目和用户。

-

希望“开箱即用”,快速开始编码和训练,避免环境配置的麻烦。

-

需要快速验证想法或复现论文结果。

-

-

如何选择:在搜索框中输入你需要的框架和版本,例如

PyTorch 2.0、TensorFlow 2.10,然后选择一个版本较新、下载量高的官方或热门镜像,通常更加稳定可靠。

-

-

我的镜像

-

是什么:这是你自定义保存的镜像。当你使用“基础镜像”或“社区镜像”后,在实例中安装了新的软件或库,可以将其制作成个人镜像并保存下来。

-

适用场景:

-

你拥有一个配置完善、满足个人长期需求的专属环境。

-

你需要在多次租用实例时,快速复现完全相同的开发环境,保证实验的一致性。

-

你希望将配置好的环境分享给团队成员。

-

-

初次使用时此项为空。在你对平台熟悉之后,这是一个能极大提升效率的高级功能。

-

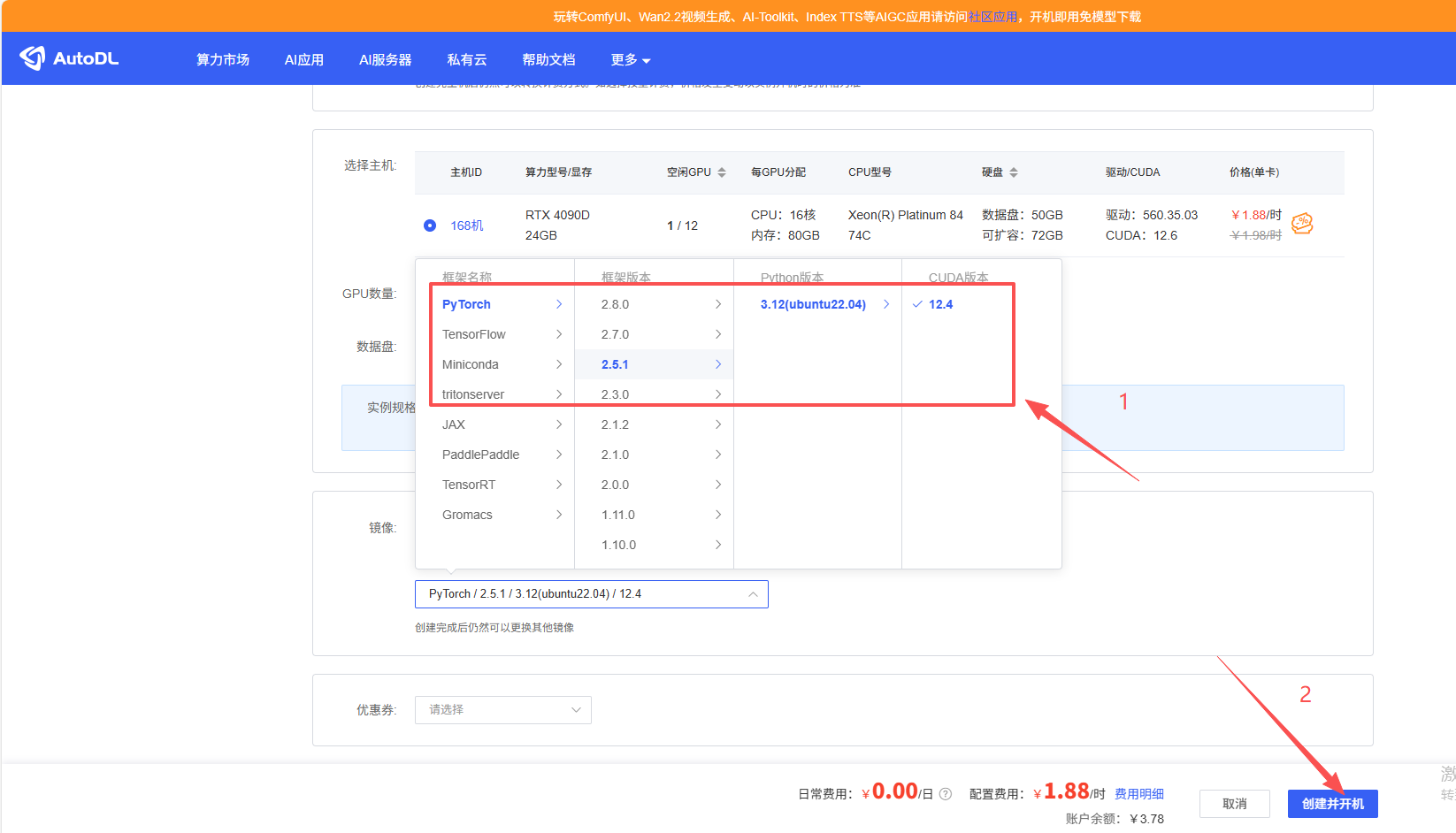

根据不同的深度学习框架配置不同的服务器,我使用的是Pytorch框架,所以这里以Pytorch为主,其他框架类似。配置好之后点击“创建并开机”

配置完之后会自动跳转到控制台容器实例界面,建议首次学习配置的时候在租用好服务器之后,关机,然后选择“无卡开机”的模式进行配置。

2. 4 打开Pycharm进行网络配置

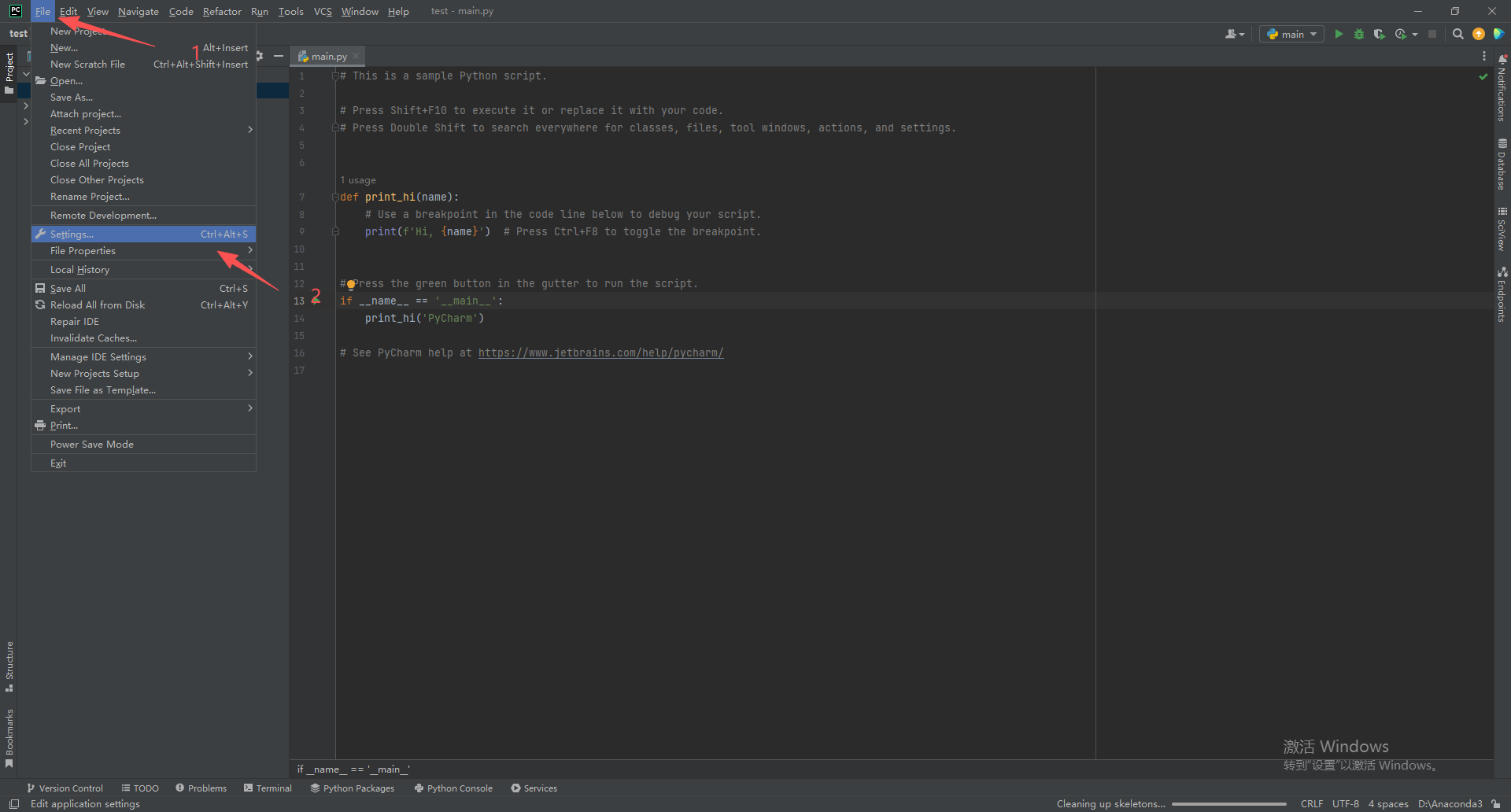

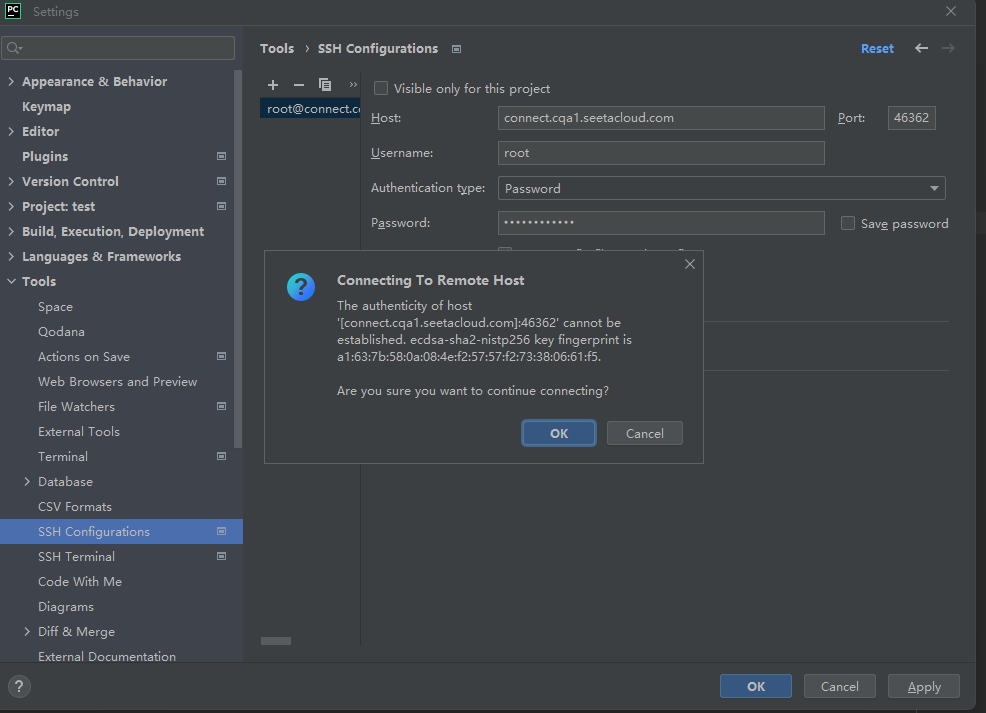

点击file->Setting

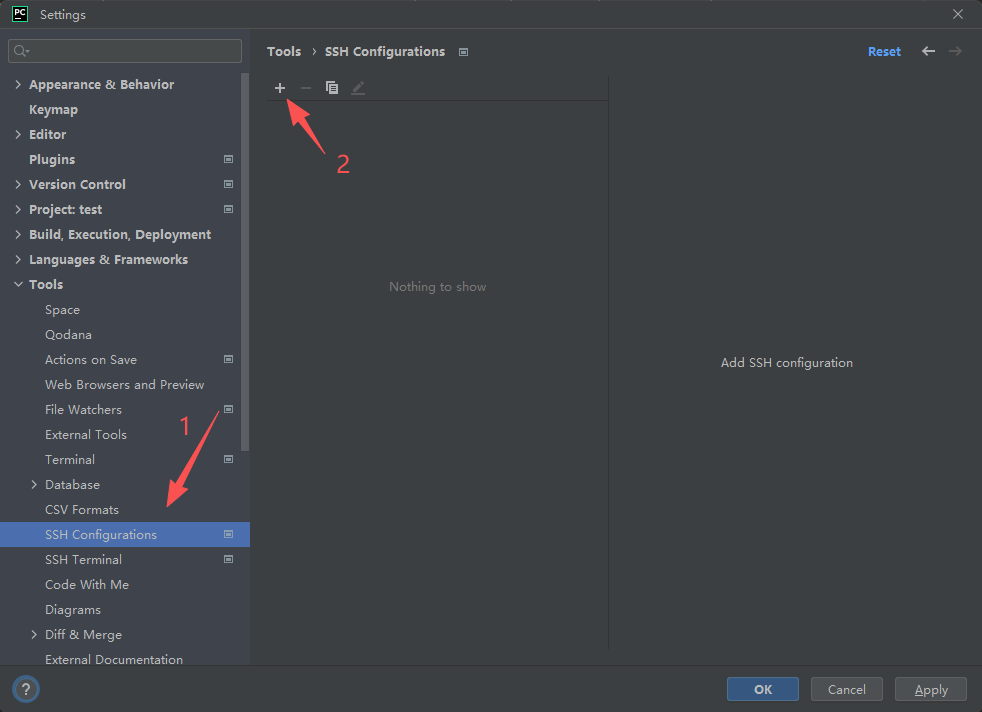

然后点击Tools->SSH Configurations

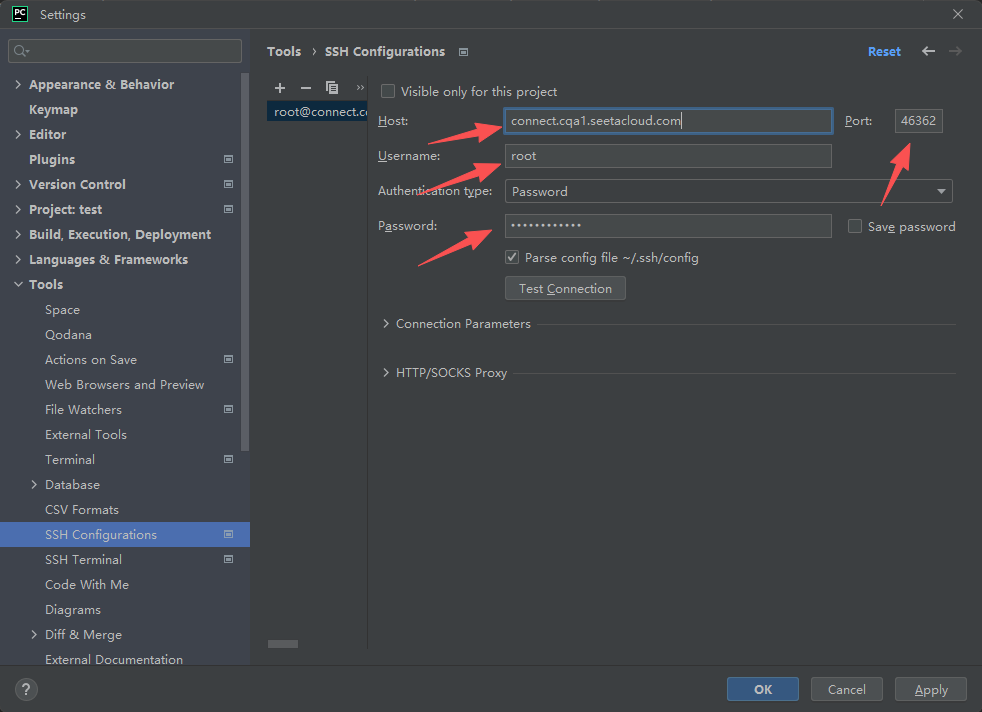

回到我们前面租用的服务器中有登录指令和密码。

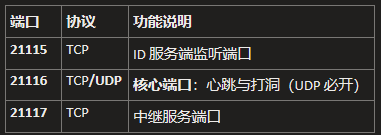

其中,具体内容如下:

登录指令: ssh -p 46362 root@connect.cqa1.seetacloud.com

密码:xxxxx(复制你们自己的即可)。

对应我们pycharm配置如下:

Host对应登录指令中@后面的内容,比如我的为:connect.cqa1.seetacloud.com

Port对应登录指令中的数字部分,比如我的为:46362

Username我们设定为:root

Passwords对应前面的密码:xxxxx,只需要复制过来即可。

点击Test Connection,测试连接是否成功。

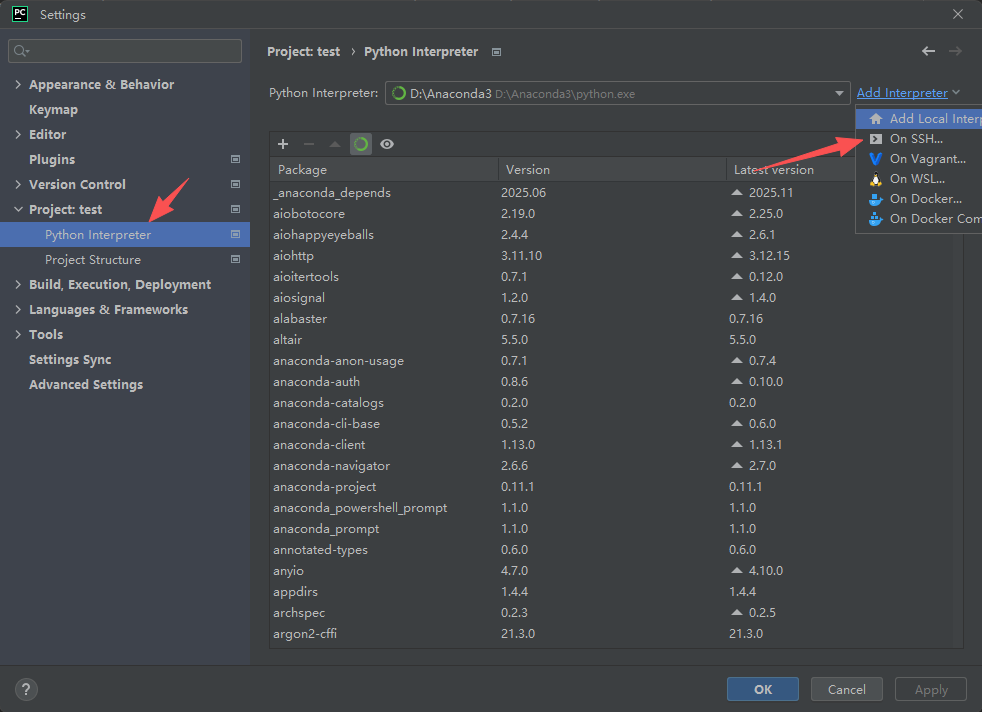

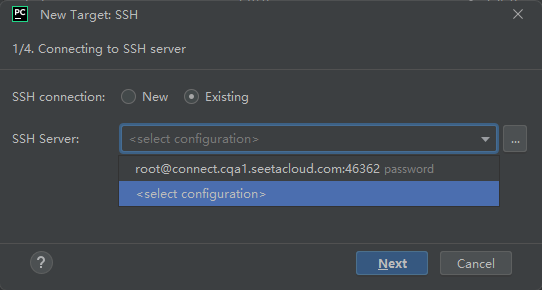

成功成功之后进行网络配置:

选择已存在的远程连接:

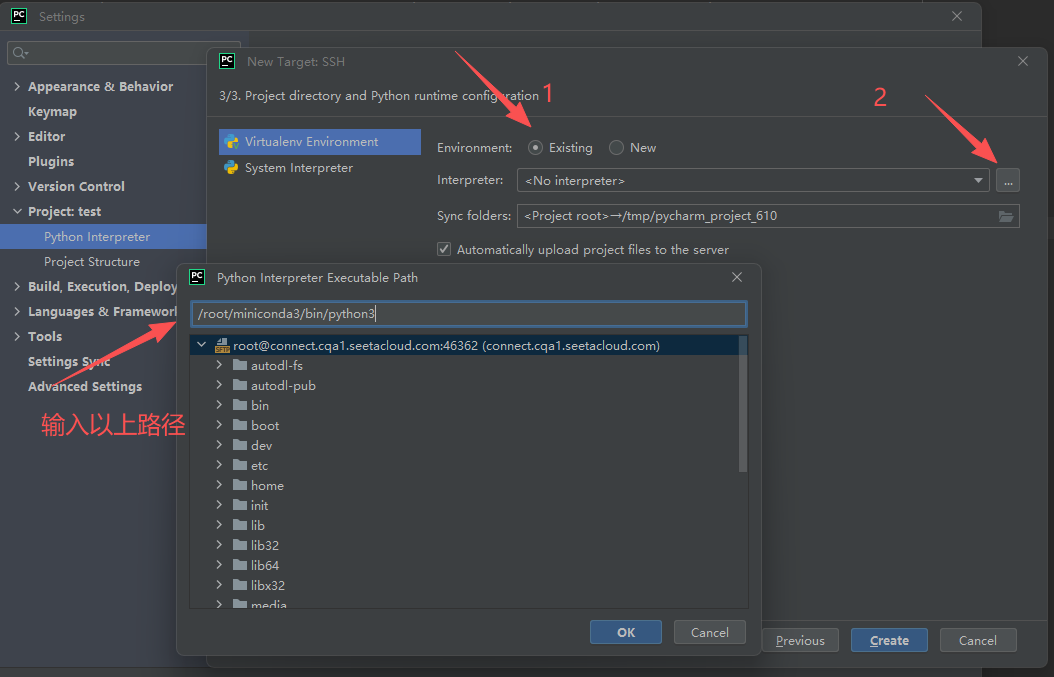

这一步是为了选择编译器,选择已存在的编译器,根据以下操作,输入编译器路径,一般是在这里,Pytorch和Tensorflow框架是这个路径。选择好之后点击OK。

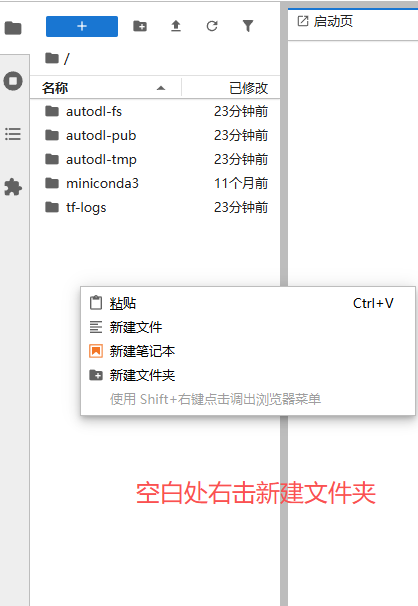

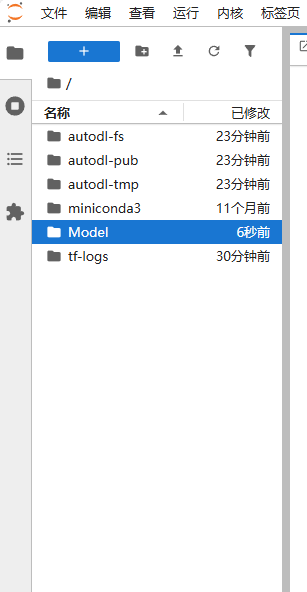

回到我们的服务器中,进入JupterLab,点击空白区创建文件夹方便后续文件管理,可以不用和你项目所在文件夹同名,比如我在服务器上是Model,但是本地是Test文件夹。

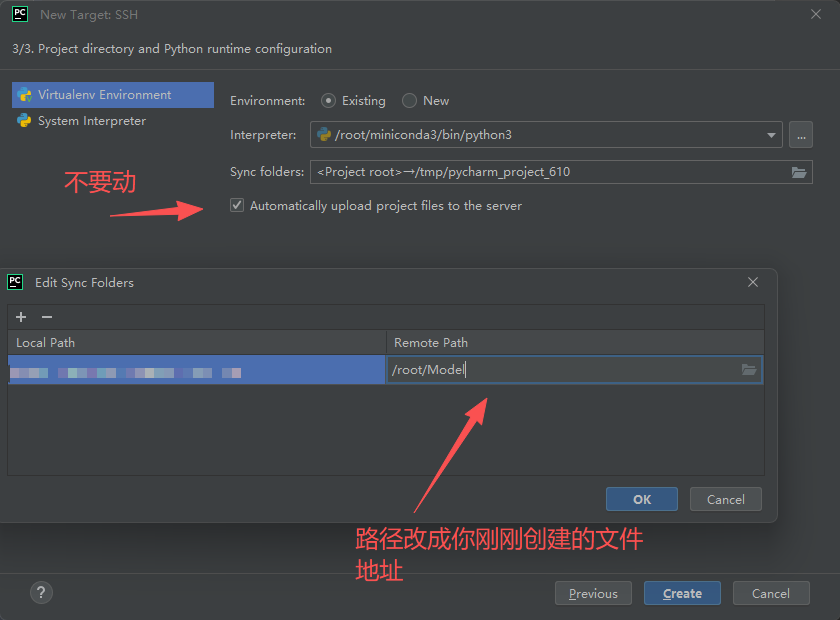

这里进行配置文件保存路径,其中Local Path不要动,这是你的本地文件所在路径,也就是你现在打开的pycharm项目路径。勾选Automatically upload Project files to the sever,这样你在本地改了代码之后他会自动上传你的代码到服务器。将Remove Path改成我们刚刚创建文件夹的路径。

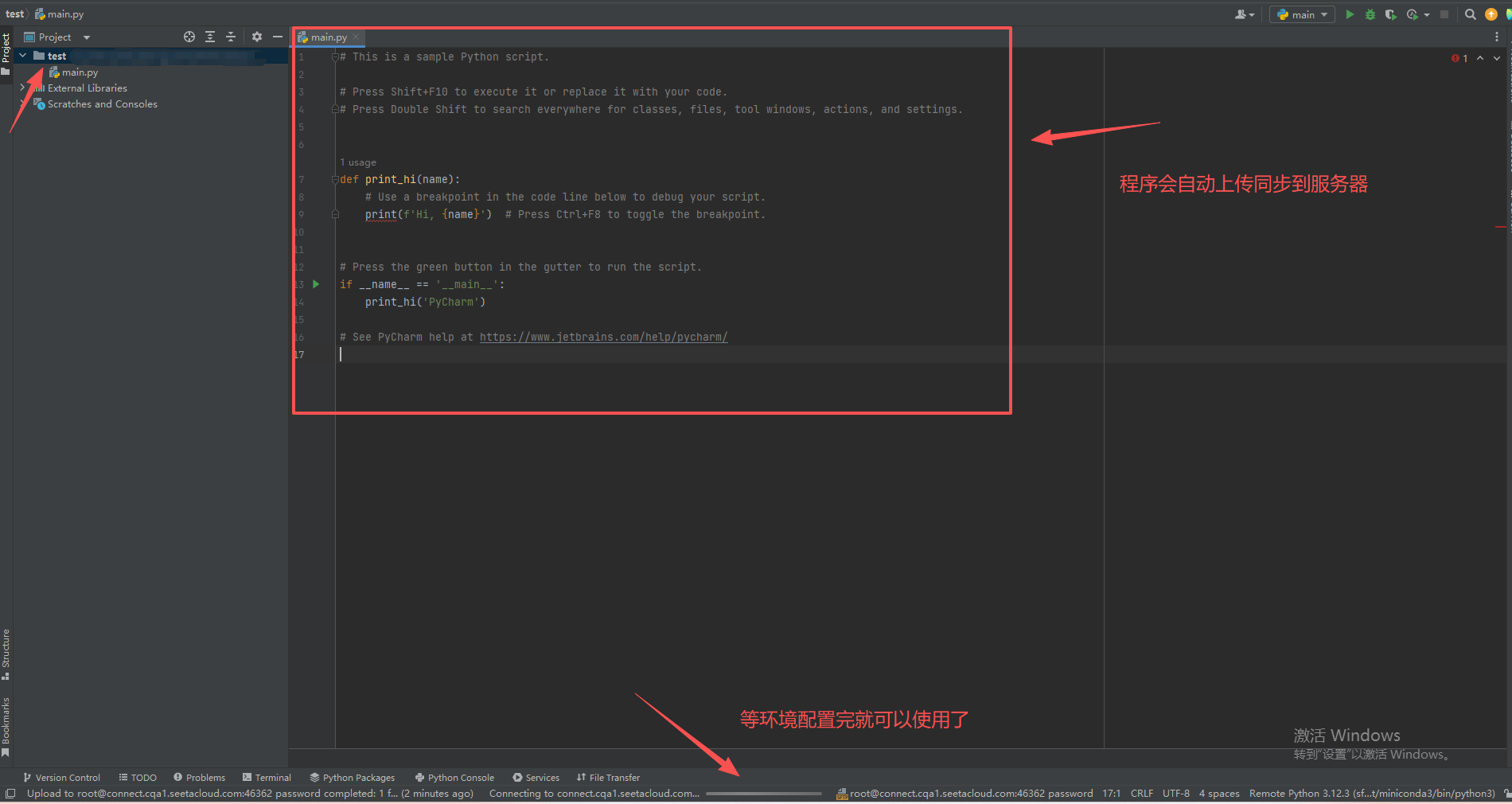

配置好之后文件会自动上传。

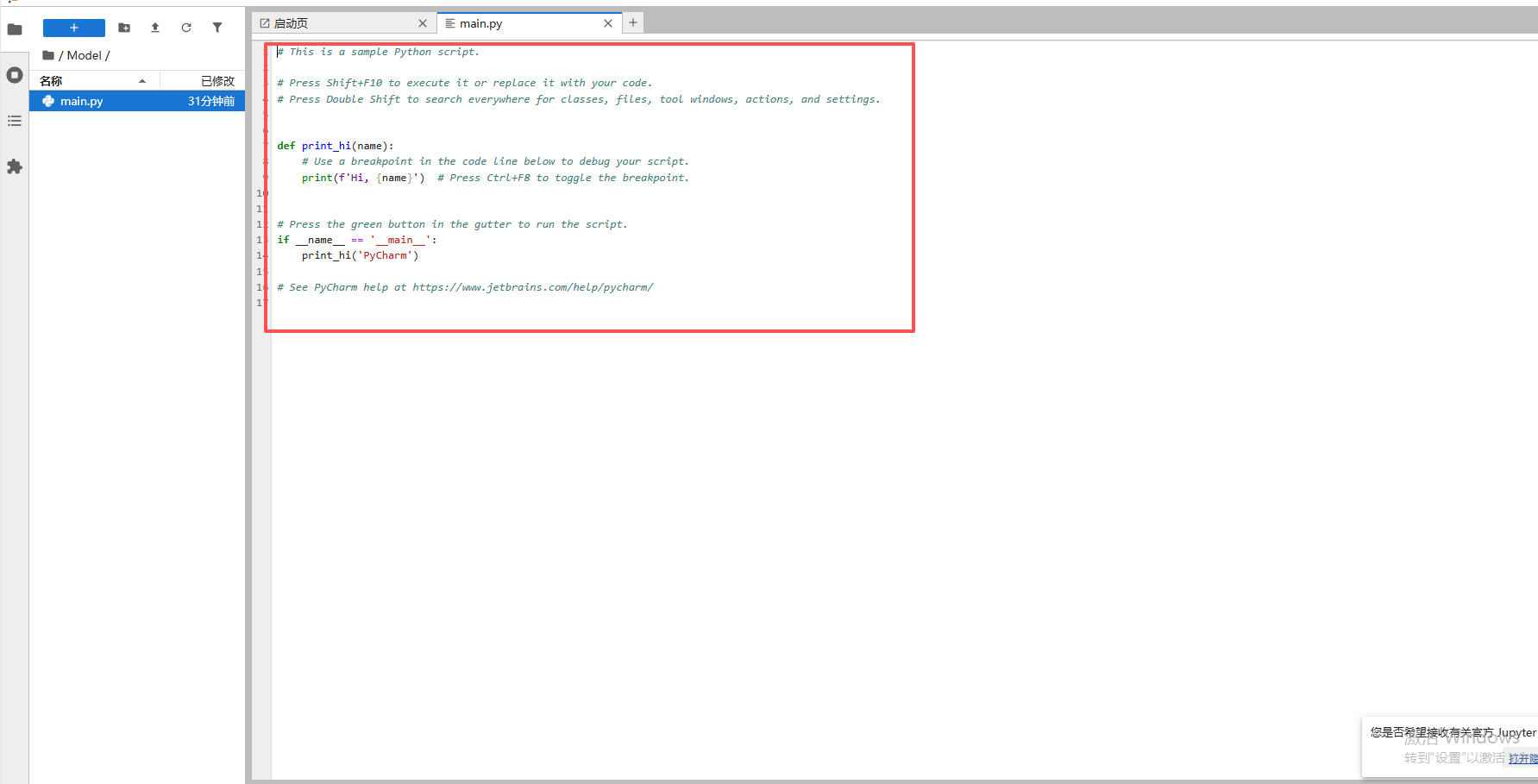

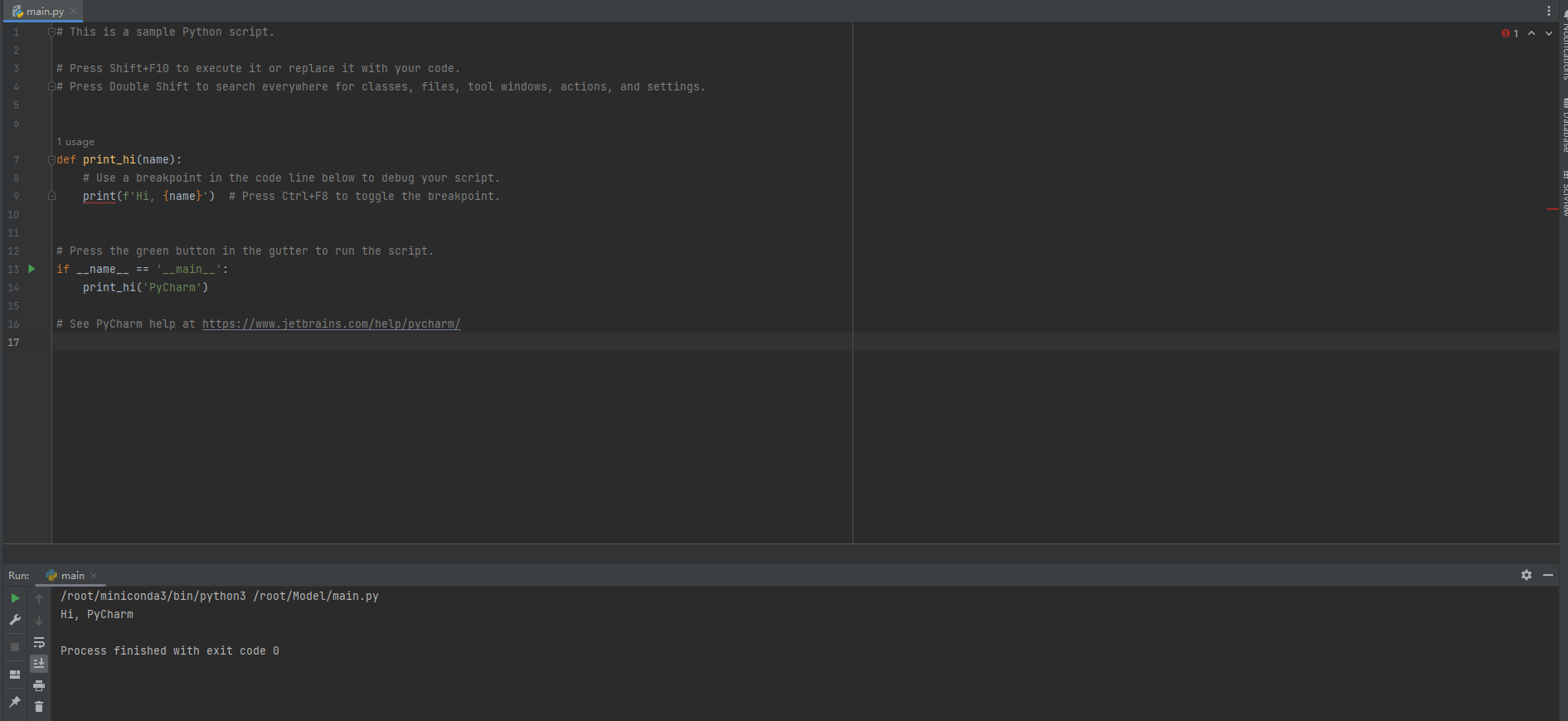

等环境运行好之后就可以编译了。

结语: 恭喜你完成了这篇博客的阅读!我衷心希望我的分享能够为你带来启发和帮助。愿你拥有一个宁静而美好的夜晚,好梦相伴。🌛🌛🌛